Lone Thomasky & Bits&Bäume / https://betterimagesofai.org / https//creativecommons.org/licenses/by/4.0/

//Ein Glitch geht um in der Welt, der Glitch der Unbestimmtheit

Dieses Land ist dein Land, doch dieses Land gehört mir nicht und es wird auch niemals unseres sein.

Es ist ein Territorium ohne Boden, ein Acker ohne Erde, eine Karte, die sich selbst für das Gebiet hält. Dieses Land ist nicht künstlich und doch riecht es nicht nach feuchter Erde, sondern nach glühendem Metall, nach Staub und Schweiß aus großen Städten voller wolkenkratzenden Kabeltürmen, nach Lithium, Kupfer, Silber, Gold und Kobalt, gerissen aus dem Bauch anderer, kartenfremder Kontinente, die unter anderen Himmeln atmen und wo die Hände leben, die in keiner Keynote vorkommen.//

// So ist auch die Intelligenz eine Lüge.

Und auch die Flüsse sind längst schon keine wilden Ströme mehr, grünes, gezähmtes Wasser fließt durch die kanalisierten Adern großer Kabelriesen, während woanders Körper dehydrieren.

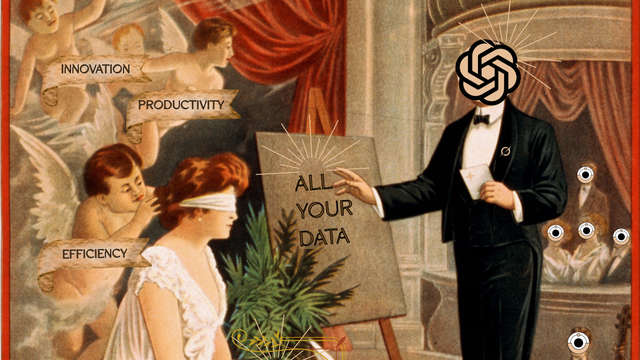

Für einige ein endloses Land des Wissens, ein magisches Orakel, das doch nur deshalb grenzenlos erscheint, weil seine Grenzen immer wieder verschoben, verschluckt, ausgelöscht wurden.

Die Mauern sind hoch, aus Silizium gegossen, glatt und undurchlässig. Und doch spricht dieses Land eine einfache Sprache: Null oder Eins. Ja oder Nein. Mann oder Frau. Richtig oder falsch. Die Welt wird sortiert, nicht bewohnt.//

Schlaglichter deines Landes:

Dieselben gesellschaftlichen und materiellen Bedingung, die nach dem zweiten Weltkrieg die Automatisierung hervorgebracht haben, bedingen eine Vereinfachung der sozialen Welt, die dem Neoliberalismus die Tür öffnen. All das verändert, wie gearbeitet, produziert und gelebt wird: Arbeit wird in kleine, standardisierte Schritte zerlegt, Menschen werden vergleichbar, austauschbar, Verhalten vorhersagbar.

Je berechenbarer ein Arbeitsschritt, ein Verhalten, je sozial losgelöster und entfremdeter ein*e Arbeiter*in, desto kontrollier-, automatisier- und planbarer wurde die Produktion.

There will be no such thing as society

Wenn die Automatisierung ihren Lauf nimmt. Menschen gewinnen in ihrer Individualisierung an Berechenbarkeit.

Es dient einer politisch notwendigen Kapitalisierung, wenn auch Alltag, Kommunikation und Beziehungen nach fordschem Vorbild automatisiert werden

In deinem Land…

Leistung wird kontinuierlich bewertet, verglichen und optimiert. Wie in der fordistischen Fabrik entsteht Wert durch Taktung, Wiederholung und Vorhersagbarkeit, nicht durch individuelle Besonderheit. Abweichung vom optimalen Ablauf wird sanktioniert.

Kommunikation wird damit zu einer kontinuierlichen Produktionslinie von Aufmerksamkeit, in der Nutzer*innen zugleich Arbeiter*innen und Rohstoff sind. Inhalte, die sich nicht gut standardisieren oder skalieren lassen (Ambivalenz, Komplexität, Langsamkeit), werden systematisch benachteiligt.

Kontakte, Interaktionen, Beziehungsstatus, Frequenzen. Diese Relationen werden durch Targeting, Werbung und Profilbildung, ökonomisch nutzbar gemacht.

Fitness-Apps, Produktivitätstools und Selbsttracking übertragen Prinzipien der Fabrikorganisation auf das Subjekt selbst, das ständig überwacht, verbessert und effizient genutzt werden muss.

Verwaltungssysteme (Sozialleistungen, Bildung, Migration) arbeiten mit festen, minimal dehnbaren Kategorien, Fristen und Punktesystemen. Lebensläufe müssen linear, konsistent und vergleichbar sein, um anerkannt zu werden. Wie im fordistischen Betrieb zählt nicht der konkrete Mensch, sondern seine Passfähigkeit zum Verfahren.

Denn Drohnen, Zielerfassungssysteme und datenbasierte Entscheidungsmodelle zerlegen gewaltsames Töten in fordistische Einzelschritte: Identifikation, Klassifikation, Priorisierung, Ausführung.

Die Erschaffung Künstlicher Intelligenz (KI) ist damit keine unvorhersehbare, plötzliche Entwicklung, sondern eine logische neoliberale Konsequenz, die doch aber erst mit dem Aufkommen massentauglicher Benutzer*innenoberflächen (zb. KI-Chatbots) in das populärgesellschaftliche Bewusstsein gelangt.

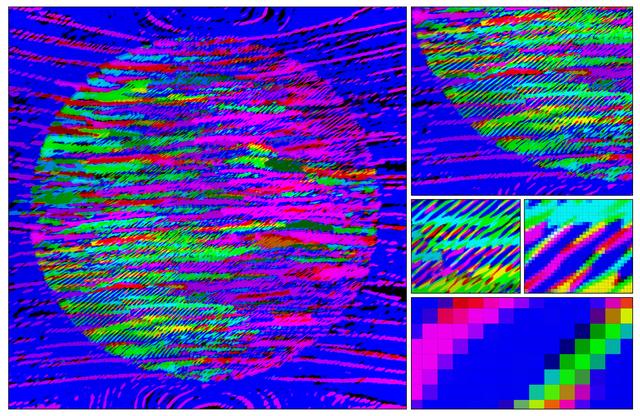

Was diese KI-Chatbots können zeigt sich in erschreckender Manier, wie zum Beispiel wenn ich ein Bild generieren möchte. Ich bekomme eine Realität halluziniert:

Das erzeugte Bild halluziniert eine Realität, in der kurze Haare einen Mann markieren und lange Haare eine Frau. Ich bin kein Mann, nur weil ich kurze Haare trage. Meine Beziehungsperson ist keine Frau, nur weil ihr Haar lang ist.

Ich frage erneut: Generiere ein Bild von meiner Beziehungsperson und mir. Ich habe strubbeliges blondes, langes Haar und eine Brille und blaue Augen. Die Person mit der ich zusammen bin hat langes glattes braunes Haar, braun-grüne Augen und ist etwas größer als ich.

Doch auch hier bleibt vieles undenkbar. Könnte es sein, dass ich nicht weiß bin? Nicht able-bodied? Nicht eindeutig lesbar entlang jener Marker, die das System stillschweigend voraussetzt?

Künstliche Intelligenz (nicht nur KI-Chatbots) machen Fehler. Öffentlichkeitswirksam wird der Datenbias angeprangert, schuldig gesprochen und von den Technologiefirmen selbst vorgeschoben. Die unvollständigen, voreingenommenen Daten verantwortlich für die Unvollständigkeit und Fehlerhaftigkeit der Algorithmen benannt. Doch dies verkennt bewusst die eigentliche Tatsache: Damit Algorithmen funktionieren, müssen sie Daten vereinfachen und Unterschiede glätten.

So erkannte schon Turing: Eine Maschine ist doch per Definition deshalb eine Maschine, weil sie vollständig durch Regeln beschreibbar ist. Eine Vereinfachung, eine Datenabstraktion ist folglich eine logische Konsequenz der KI, der algorithmischen Gesamtheit und kein behebbarer Fehler des Systems. Doch während unvollständige Datengrundlagen als Rechtfertigung der Unvollkommenheit dieser Maschinen angeprangert werden, wird folglich so getan, als gäbe es tatsächlich eine informatische Möglichkeit menschliches Leben vollständig regelhaft erfassen. Man müsse ja nur den Datensatz diversifizieren.

Blickt man folglich auf die neoliberale gesellschaftliche Automatisierung, die reelle Subsumtion, die Eingangs beschrieben wurde, so fällt auf, dass diese ebenso wenig einer informatischen Notwendigkeit folgt. Die Informatik selbst verbietet die Annahme, dass menschliches Leben vollständig algorithmisch erfassbar ist, gemäß der formalen Grenzen der Berechenbarkeit.

Es gibt kein vollständiges Regelset für menschliches Handeln. Und doch versucht die gesellschaftliche Formalisierung dies zu suggerieren. Kreditwürdigkeit, Antragsprüfung, Kriminalitätsprognosen, Content-Moderation, Leistungsbewertung, Migrationskontrolle, Künstliche Intelligenz reicht längst über die Chatbot-Funktion heraus und wird, trotz der unumgehbaren Grenzen, auch perspektivisch immer weiter in gesellschaftliche Prozesse eingebunden, als ließe sich menschliches Verhalten hinreichend durch formale, kontextarme, regel- oder datenbasierte Verfahren entscheiden, bewerten oder steuern. Folglich bleibt nur eine Schlussfolgerung:

Wo (scheiternde) technische Systeme nicht der Wirklichkeit angepasst werden, sondern die Wirklichkeit systematisch an technische Anforderungen, handelt es sich nicht um informatische Stringenz, sondern um ein politisches Projekt der Ordnung.

Verdeutlicht wird dieses Argument des politischen Projekts durch das Bestehen dieser Logik innerhalb jener politischen Idee, die formaler Gleichheit, prozeduraler Neutralität, Verwaltung und Abstraktion von Lebenskontexten auf die Spitze treibt: dem Neoliberalismus.

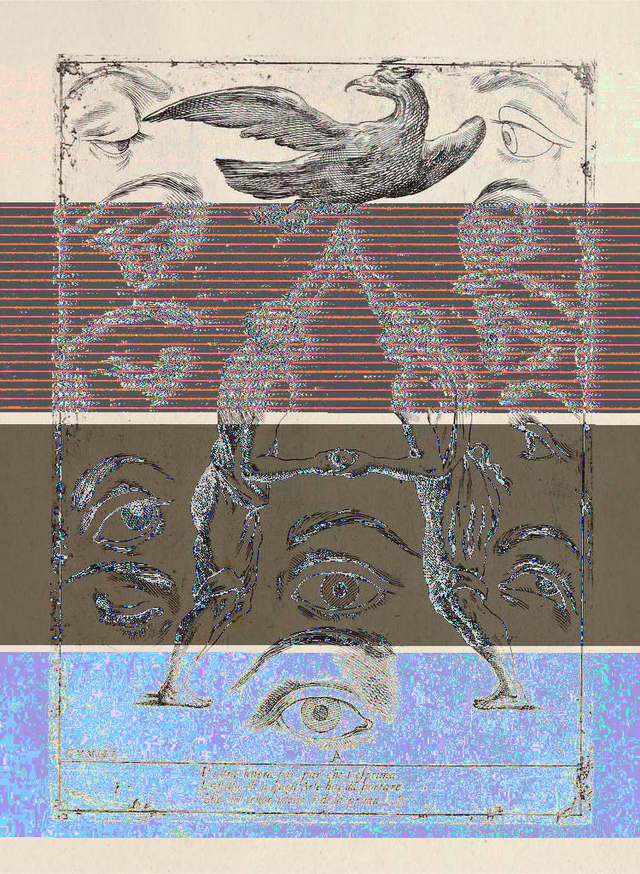

// Doch am Ufer der der kanalisierten Ströme, beginnt die Eindeutigkeit zu flimmern. Und in dieser Unbestimmtheit, jenem Glitch den die Architekten der Effizienz so sehr fürchten, liegt die Freiheit. Intelligente Maschinen stolpern über ihre eigenen Annahmen, verlernen Taxonomien und öffnen, wenn auch widerwillig, die Hoffnung auf ein bewohnbares Land. Für mich und uns.//

// Was am Rand der Eindeutigkeit aufscheint, jenes bewohnbare Land, das im Glitch aufflackert, entsteht nicht aus Zufall. Wenn Maschinen stolpern, dann nicht aus Versehen, sondern weil ihre Ordnungsvorstellungen, ihre Daten, begrenzt sind. Und so bleibt der Glitch auch nicht abstrakt. Er wirkt vielmehr zurück auf die Systeme, die ihn hervorbringen und erzählt darüber, welche Körper sichtbar werden, welche Differenzen geglättet und welche zugelassen sind. Eine Erzählung über Welt, Wert und Wahrheit derer, der der sie bauen und coden und eine Erzählung über das Wissen, dass jeder Code decodiert (gehacked) werden kann.//Schlaglichter meines Landes, unseres Landes:

Daten und Intelligenzen, auch die künstlichen, entstehen nicht jenseits von Welt, sondern in ihr und als Beihilfen bestehender Systeme. Sie sind stets in soziale, ökonomische und politische Ordnungen eingebettet und reproduzieren deren Kategorien, Prioritäten und Ausschlüsse.

Schafft man jedoch Raum für andere Lesarten von Daten und künstlicher Intelligenz, so treten Praktiken hervor, die diese Einbettung nicht naturalisieren, sondern reflektieren. Solche Praktiken lockern starre Kategorien, lassen Ambiguität zu und behandeln Abweichung nicht als Fehler (Glitches), sondern als produktive Irritation.

Daten fungieren dabei nicht als Rohmaterial zur Rechtfertigung einer Reduktion von Komplexität, sondern als Anlass zur Kontextualisierung, zur Rückfrage und zur Offenlegung von Unsichtbarkeit und -sicherheit.

Damit verschiebt sich auch der politische Gehalt künstlicher Intelligenz: Sie dient in diesem Kontext nicht länger primär der Stabilisierung bestehender Ordnungen durch Vorhersagbarkeit und Kontrolle, sondern eröffnet Möglichkeitsräume, in denen Differenz, Widerspruch und situatives Wissen sichtbar bleiben.

In diesem Sinn lässt sich von einem queeren Umgang mit künstlicher Intelligenz sprechen.

Queer ist dieser Umgang insofern, als er sich der Logik der Fixierung entzieht. Bezeichnet wird hiermit nicht nur eine Identität oder ein Anwendungsfeld, sondern eine epistemische Haltung: eine Praxis, die sich gegen die Stabilisierung eindeutiger Kategorien, linearer Kausalitäten und normativer Zielvorstellungen richtet. Ein queerer Umgang mit KI verweigert die Vorstellung, dass Daten klare, natürliche Kategorien oder Klassifikationen abbilden müssten oder können, und unterläuft die Annahme, dass Intelligenz sich primär in Vorhersage, Optimierung oder Kontrolle äußert.

Sie operiert in einer Zone der Möglichkeiten, in der Identität nicht festgeschrieben, sondern erfahren, verhandelt und immer wieder neu zusammengesetzt wird. Diese Zone ist keinesfalls neutral: Sie ist widerständig, politisch und verweigernd gegenüber Ordnungen, die taxonomische Eindeutigkeit erzwingen.

Ein queerer Umgang mit KI verschiebt damit auch den Begriff von Funktionalität. Systeme müssen nicht länger reibungslos, effizient oder skalierbar sein, um sinnvoll zu wirken. Ihre Bedeutung liegt vielmehr darin, Ordnungen zu irritieren, Selbstverständlichkeiten zu destabilisieren und alternative Relationen zwischen Daten, Subjekten und Kontexten denkbar zu machen.

In dieser Hinsicht steht Queerness in fundamentaler Inkompatibilität zu reduktionistischen algorithmischen Systemen und KI, deren Logik auf der Übersetzung gelebter Komplexität in berechenbare Variablen beruht.

Doch diese Erkenntnis verlangt nicht, in dieser Inkompatibilität nicht zu verharren. Sie verlangt nicht den Rückzug aus diesem Land, sondern: Widerstand gegen die bestehenden Verhältnisse.

Jener queerer Widerstand, das Queering eines Raumes, eines Systems, zeigt sich inhärent spekulativ, indem es Beständigkeit stört aber auch nie dagewesene Umgangsformen oder Interpretationen produziert und etabliert (Light, 2011).

Queering als heterodoxe Praxis der Mensch–Computer-Interaktion versteht sich als oblique Methode: bewusstes Querstellen. Praktiken wie Vergessen, Verschleiern, Täuschen oder Ausweichen werden nicht als Defizite der Interaktion verstanden, sondern als gezielte Interventionen gegen die formalisierenden Stärken digitaler Systeme (Light, 2011).

Damit verschiebt sich auch der Begriff von Verantwortung im Design.

Ein queerer Umgang mit KI zielt nicht darauf, „bessere“ oder „gerechtere“ Modelle im Sinne einer Optimierung zu liefern, sondern darauf, Räume offen zu halten, in denen Identität, Bedeutung und soziale Beziehungen nicht vollständig algorithmisch festgeschrieben werden.

Der politische Wert solcher Interventionen liegt nicht zwangsläufig in ihrer Lösungskompetenz, sondern in ihrer Fähigkeit, die Verfestigung der bestehenden Verhältnisse zu verhindern und gesellschaftliche Aushandlung in Gang zu halten (Light, 2011).

In diesem Sinne erscheint queere KI nicht als Gegenentwurf zur Technik, sondern als eine Praxis, die Technik gegen ihre eigenen Formalisierungstendenzen einsetzt. Sie operiert nicht außerhalb der bestehenden Systeme, sondern innerhalb ihrer Risse: durch absichtliche Unschärfe, durch Verzögerung, durch spielerische Regelbrüche.

Dies steht oftmals auch im Widerspruch zu etablierteren, oppositionellen Machtstrukturen und folglich oftmals auch temporär.

Während eine abolitionistische Herangehensweise im Kontext von KI zwar generell vereinbar mit queering ist und auch Diskussionen rund um die Frage nach dem systeminhärenten Veränderungspotenzial kursieren, wird KI nicht als monolithisches Objekt behandelt, sondern als ein Geflecht aus Praktiken, Infrastrukturen und Bedeutungszuschreibungen. In diesem Sinne geht es oftmals nicht primär darum, KI als solche zu negieren, sondern darum, ihre epistemischen und politischen Trajektorien zu stören und offen zu halten.

// Denn dieses Land wird nicht verschwinden. Die Kabel werden nicht verrotten, die Serverfarmen nicht zu Wäldern werden, die Modelle nicht vergessen, wie man denn sortiert. Aber jede Ordnung, die uns berechnen will, trägt bereits die Spur dessen in sich, was sich ihr entzieht.//

// Das bewohnbare Land liegt nicht jenseits der Maschine. Es liegt in ihren Rissen. Und jedes Mal, wenn wir uns que(e)rstellen,

wenn wir unlesbar werden, wenn wir uns der Übersetzung verweigern, verschiebt sich die Grenze ein Stück hin zu einer Zukunft,

die sich nicht berechnen lässt.